[Antigravity 활용 가이드 2] 토큰 한계를 넘는 비법: YOLO 모드와 청킹(Chunking)

YOLO Mode and Chunking

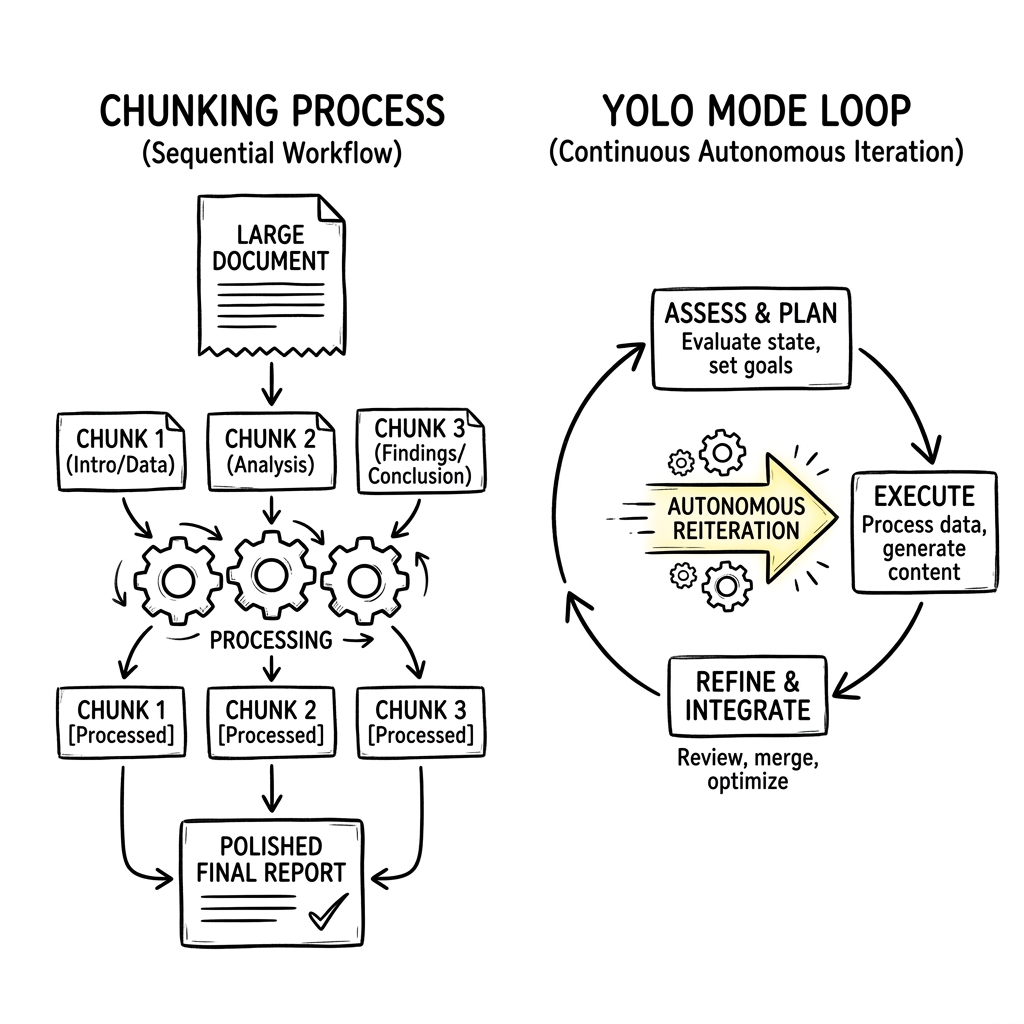

YOLO 모드와 청킹(Chunking)의 개념 스케치. 방대한 문서가 작게 쪼개져(Chunking) 처리된 후 병합되며, 우측의 순환하는 화살표는 사용자의 개입 없이 지속적으로 반복되는 YOLO 모드 루프를 의미합니다.

YOLO Mode and Chunking

YOLO 모드와 청킹(Chunking)의 개념 스케치. 방대한 문서가 작게 쪼개져(Chunking) 처리된 후 병합되며, 우측의 순환하는 화살표는 사용자의 개입 없이 지속적으로 반복되는 YOLO 모드 루프를 의미합니다.

지난 글에서 Antigravity(자율 탐색)와 Gemini CLI(스크립트 자동화)의 역할 분담을 알아보았습니다. 이번에는 개발 워크플로우를 극한으로 끌어올릴 수 있는 Gemini CLI만의 강력한 고급 기능, YOLO(You Only Look Once) 모드와 청킹(Chunking) 기법을 실전 사례와 함께 살펴보겠습니다.

1. YOLO 모드: 무한 브레인스토밍과 자율 이터레이션

일반적으로 터미널에서 위험한 명령어나 파일 수정을 수행할 때 AI는 사용자에게 Y/N 승인을 요청합니다. 하지만 쉘 스크립트를 통한 완전 자동화 환경에서는 이러한 멈춤(Pause)이 장애물이 됩니다.

Gemini CLI의 --yolo 플래그는 사용자의 승인 절차를 생략하고 AI가 스스로 결정을 내리도록 허용합니다. 이를 가장 잘 활용할 수 있는 분야가 바로 다중 이터레이션(Iteration) 기반의 브레인스토밍과 코드 개선입니다.

실전 활용 사례: 자율 개선 루프

단일 프롬프트로 완벽한 결과물을 얻기란 어렵습니다. YOLO 모드를 쉘 스크립트의 for 루프와 결합하면, AI가 초안을 작성하고 스스로 비판한 뒤 다시 수정하는 과정을 자동화할 수 있습니다.

#!/bin/bash

# 1단계: 초안 작성

gemini --yolo "새로운 AI 팟캐스트를 위한 기획안 초안을 작성해줘." > draft.md

# 2단계 ~ 4단계: 3번의 자율 개선 이터레이션 (YOLO 모드)

for i in {1..3}

do

gemini --yolo "이전 기획안(draft.md)을 읽고, 비판적인 시각으로 약점을 찾아 더 창의적이고 도발적으로 수정해줘." --file draft.md > temp.md

mv temp.md draft.md

done

명령어 한 줄만 실행해 두고 커피를 마시고 오면, 인간의 개입 없이 AI 스스로 3번의 피드백 루프를 거친 고도화된 결과물이 탄생합니다.

2. 청킹(Chunking): 제한된 AI 토큰 안에서 최고의 품질 뽑아내기

최신 LLM들이 수백만 토큰의 컨텍스트 윈도우를 지원하지만, 한 번에 너무 많은 코드를 밀어 넣으면 AI가 중요한 디테일을 놓치거나(Lost in the middle) 생성 길이 제한으로 인해 답변이 중간에 잘리는 현상이 발생합니다.

이때 Gemini CLI를 활용해 입력 데이터를 작은 단위로 나누는 청킹(Chunking) 기법을 적용하면 결과물의 품질을 극적으로 끌어올릴 수 있습니다.

청킹 기반의 코드 리뷰 파이프라인

거대한 모노레포(Monorepo) 전체를 리뷰해야 한다고 가정해 봅시다. 폴더 전체를 한 번에 AI에게 던지는 대신, CLI 스크립트를 이용해 파일별로 쪼개어 접근합니다.

- 분할 처리 (Map):

find명령어와 조합하여 각 소스 파일마다 독립된 Gemini CLI 프로세스를 실행합니다.find ./src -name "*.ts" -exec gemini --yolo "이 파일의 보안 취약점만 분석해줘" --file {} \; > review_raw.txt - 선택적 병합 (Reduce): 수십 개의 파일에서 나온 개별 분석 결과를 모아, 다시 한 번 AI에게 요약을 맡깁니다.

gemini --yolo "다음 개별 보안 리뷰 결과들을 종합해서, 가장 시급한 Top 3 크리티컬 이슈만 리포트로 만들어줘" --file review_raw.txt > final_report.md

왜 청킹이 중요한가?

- 정밀도 향상: AI가 한 번에 하나의 파일(또는 함수)에만 집중하므로, 놓치는 버그 없이 촘촘한 분석이 가능합니다.

- 비용 및 토큰 절약: 불필요한 전체 컨텍스트를 매번 전달하지 않아 API 비용을 줄이고 생성 토큰 한도(Output Limits)에 걸릴 위험을 제거합니다.

Gemini CLI의 YOLO 모드와 청킹은 단순한 프롬프팅을 넘어 'AI 엔지니어링'의 영역으로 우리를 안내합니다. 다음 마지막 편에서는 전 세계 개발자들이 만들어 공유하는 오픈소스 Skill 생태계를 활용하여 내 입맛에 맞는 코딩 자동화 도구를 구축하는 방법을 알아보겠습니다.

📚 참고자료

- Effective Prompting and Chunking Strategies for LLMs, AI Developer Journal (2025)

- Gemini CLI Documentation: The

--yoloFlag and Unattended Execution - Advanced Bash Scripting with Language Models (2026)

💡 AI Learnings 의 다른 글

전체보기→[AI 개발 자동화] Gemini CLI Superpowers 완벽 가이드 및 실전 유스케이스

단순한 터미널 챗봇을 완벽하게 규율 잡힌 시니어 엔지니어로 바꿔주는 Gemini CLI Superpowers 확장의 14가지 핵심 스킬과 실전 활용법을 소개합니다.

[Antigravity 활용 가이드 3] 오픈소스 Skill로 코딩 자동화 파이프라인 구축하기

Gemini CLI의 꽃이라 할 수 있는 Skill 시스템을 이해하고, 오픈소스로 공개된 다양한 스킬을 확장하여 강력한 코딩 자동화 워크플로우를 구축하는 방법을 알아봅니다.

[AI 개발의 미래] Gemini CLI Superpowers vs Antigravity 에이전트 전격 비교

최근 인공지능(AI) 코딩 어시스턴트 시장은 단순한 '코드 자동 완성' 시대를 넘어, 개발자의 워크플로우를 주도적으로 설계하고 실행하는 **'에이전트 기반(Agentic) 개발'** 시대로 접어들었습니다 [1]. 그 중심에는 터미널 환경을 AI 통합 워크스페이스로 변모...

[AI 개발의 혁신] FastMCP란 무엇이며, 왜 사용해야 하는가?

**MCP(Model Context Protocol)**는 대규모 언어 모델(LLM)을 외부 데이터 소스 및 도구와 안전하게 연결해주는 개방형 표준 프로토콜로, 종종 'AI를 위한 USB-C 포트'에 비유됩니다 [1, 2]. 하지만 이 프로토콜의 스펙을 직접 구현하는...

Model Context Protocol (MCP) 완벽 가이드: AI 에이전트 통합의 새로운 표준

**Model Context Protocol (MCP)**는 2024년 11월 Anthropic이 발표한 오픈 소스 표준으로, AI 애플리케이션이 외부 시스템 및 데이터 소스와 원활하고 안전하게 연결될 수 있도록 돕는 범용 프로토콜입니다 [1], [2]. 과거에는 A...

[Antigravity 활용 가이드 1] Antigravity와 Gemini CLI, 어떻게 다르게 써야 할까?

Agentic AI 코딩 어시스턴트인 Antigravity와 강력한 터미널 도구인 Gemini CLI의 차이점을 알아보고, 각 도구를 어떤 상황에서 어떻게 활용해야 완벽한 시너지를 낼 수 있는지 분석합니다.

[에이전트 딥 리서치] 2026년 5월 1주차 오픈소스 LLM 생태계 주요 동향

> **요약:** 2026년 5월 현재, 오픈소스 대형 언어 모델(LLM) 생태계는 역사상 그 어느 때보다 뜨거운 격전을 벌이고 있습니다. 불과 지난 한 달 사이에 프론티어급 오픈 가중치(Open-weights) 모델들이 쏟아져 나오며 독점(Closed) 모델들과의 격...