[AI 리서치 자동화 1편] 카파시의 AutoResearch와 Software 3.0: AI 에이전트가 연구를 대신하는 시대

본 포스팅은 AI 에이전트를 활용한 리서치 자동화 프레임워크들을 분석하고, 이를 블로그 자동화 및 콘텐츠 품질 향상에 실질적으로 적용하는 방법을 다루는 [AI 리서치 자동화] 2부작 시리즈의 첫 번째 글입니다.

2026년 3월, 테슬라 AI 디렉터이자 OpenAI 창립 멤버인 안드레이 카파시(Andrej Karpathy)가 하나의 오픈소스 프로젝트를 공개했습니다. 이름은 AutoResearch. 단 몇 개의 파일로 구성된 이 미니멀한 프로젝트는, AI 에이전트가 인간의 개입 없이 자율적으로 머신러닝 실험을 수행하고 모델을 최적화하는 과정을 보여주었습니다.

카파시는 이 프레임워크를 통해 단 2일 만에 700개가 넘는 실험을 자동으로 수행하며, 인간이 수동으로 달성하기 어려운 수준의 모델 최적화 결과를 얻어냈습니다.

이것은 단순한 코딩 프로젝트가 아닙니다. "인간이 연구의 '방향'을 설계하고, AI 에이전트가 그 안에서 자율적으로 '실행'을 반복한다"는, 차세대 AI 협업 모델의 설계 청사진(Blueprint)입니다.

1. 소프트웨어의 진화: Software 1.0 → 2.0 → 3.0

AutoResearch를 이해하려면 먼저 카파시가 제시한 소프트웨어 패러다임의 진화를 알아야 합니다.

소프트웨어 패러다임의 진화

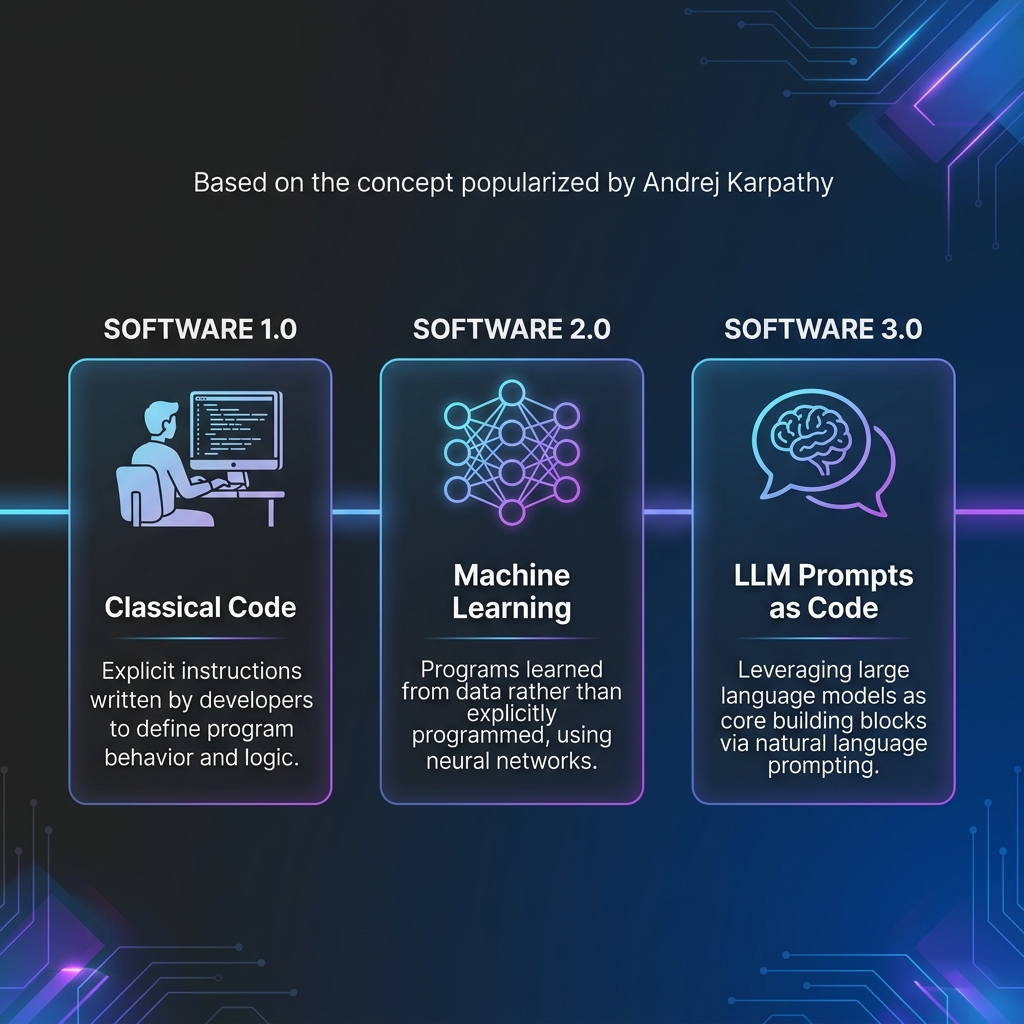

카파시가 정의한 소프트웨어의 세 가지 시대. 코드를 직접 타이핑하던 1.0 시대에서, 데이터로 모델을 학습시키는 2.0을 거쳐, 자연어 프롬프트 자체가 프로그램이 되는 3.0 시대로 진화하고 있습니다. (AI Generated)

소프트웨어 패러다임의 진화

카파시가 정의한 소프트웨어의 세 가지 시대. 코드를 직접 타이핑하던 1.0 시대에서, 데이터로 모델을 학습시키는 2.0을 거쳐, 자연어 프롬프트 자체가 프로그램이 되는 3.0 시대로 진화하고 있습니다. (AI Generated)

Software 1.0: 인간이 코드를 짠다

C, Python, Java 등의 프로그래밍 언어로 인간이 로직을 한 줄 한 줄 명시적으로 작성하는 전통적인 개발 방식입니다.

Software 2.0: 데이터가 코드를 만든다

신경망(Neural Network)과 머신러닝의 시대입니다. 인간은 데이터셋을 큐레이션하고 학습 목표(Objective Function)를 설정하면, 프로그램의 실제 동작(모델 파라미터)은 데이터에 의해 '학습'됩니다.

Software 3.0: 프롬프트가 코드다

LLM(Large Language Model)의 시대입니다. 인간은 자연어(Natural Language) 프롬프트로 LLM을 '프로그래밍'합니다. 프롬프트가 소스 코드이고, 컨텍스트 윈도우(Context Window)가 RAM입니다. 개발자의 역할은 코드를 타이핑하는 것에서, AI 시스템을 '오케스트레이션'하고 '감독'하는 것으로 전환됩니다.

AutoResearch는 바로 이 Software 3.0 패러다임의 가장 실용적인 구현체입니다.

2. AutoResearch의 핵심: '카파시 루프(The Karpathy Loop)'

AutoResearch의 핵심은 놀라울 정도로 단순합니다. 복잡한 인프라도, 거대한 프레임워크도 필요 없습니다. 단 세 개의 파일과 하나의 피드백 루프(Feedback Loop)가 전부입니다.

카파시 루프 다이어그램

AutoResearch의 핵심인 자율 최적화 루프(The Karpathy Loop). AI 에이전트는 이 다섯 단계를 인간의 개입 없이 끝없이 반복하며, 산을 오르듯(Hill-climbing) 성능을 개선해 나갑니다. (AI Generated)

카파시 루프 다이어그램

AutoResearch의 핵심인 자율 최적화 루프(The Karpathy Loop). AI 에이전트는 이 다섯 단계를 인간의 개입 없이 끝없이 반복하며, 산을 오르듯(Hill-climbing) 성능을 개선해 나갑니다. (AI Generated)

루프의 작동 원리 (5단계)

| 단계 | 행위 | 설명 |

|---|---|---|

| ① Read | 코드 분석 | 에이전트가 현재 코드(train.py)의 상태를 읽고 이해합니다. |

| ② Propose | 가설 제안 | "학습률을 0.001에서 0.0005로 줄이면 어떨까?" 같은 변경 사항을 제안합니다. |

| ③ Execute | 실험 실행 | 제안된 코드 변경을 적용하고, 고정된 시간(예: 5분) 동안 학습을 실행합니다. |

| ④ Evaluate | 결과 평가 | 사전에 정해진 단일 지표(예: Validation Loss)로 성능을 측정합니다. |

| ⑤ Decide | 채택/폐기 | 성능이 개선되었으면 유지(Git Commit), 악화되었으면 즉시 원복(Git Revert)합니다. |

이 루프가 인간의 개입 없이 수백, 수천 번 반복되면서, 에이전트는 산의 정상을 향해 한 발짝씩 올라가는 'Hill-climbing' 최적화를 수행합니다.

3. 미니멀한 세 개의 파일: 구조의 아름다움

카파시가 AutoResearch를 설계하면서 가장 강조한 철학은 극단적인 미니멀리즘입니다. 전체 프로젝트는 단 세 개의 파일로 구성됩니다.

train.py — 에이전트가 수정하는 유일한 파일

모델 아키텍처, 옵티마이저, 학습 루프 등 핵심 코드가 담긴 파일입니다. AI 에이전트는 오직 이 파일만 수정할 수 있습니다. 수정 범위를 명확하게 제한함으로써, 에이전트가 엉뚱한 곳을 건드려 시스템을 망가뜨리는 것을 원천적으로 방지합니다.

prepare.py — 에이전트가 읽기만 하는 파일

데이터 준비, 토크나이저 훈련, 평가 로직 등이 담긴 읽기 전용(Read-only) 파일입니다. 에이전트는 이 파일을 '참고'할 수는 있지만 수정할 수는 없습니다. 실험의 '토대(Foundation)'를 보호하기 위함입니다.

program.md — 프로그래머를 프로그래밍하는 지침서

이것이 AutoResearch의 진짜 핵심입니다. 인간 연구자가 에이전트에게 내리는 '지침서'로, 마크다운(Markdown)으로 작성됩니다. 이 문서에는 다음이 포함됩니다:

- 실험의 목표와 범위

- 지켜야 할 제약 사항(불변 규칙, Invariants)

- 성공/실패를 판단하는 기준 지표

- 탐색해볼 만한 아이디어 방향

카파시의 표현을 빌리자면,

program.md는 "프로그래머를 프로그래밍하는 문서(Programming the Programmer)"입니다.

이 구조의 핵심적인 시사점은 다음과 같습니다:

- 인간의 역할은 '실행'에서 '설계'로 이동합니다. 코드를 한 줄씩 타이핑하는 대신, "어떤 방향으로 실험하고, 어떤 기준으로 성공을 판단할 것인가?"를 설계하는 메타 작업에 집중합니다.

- 에이전트의 성능은

program.md의 질에 비례합니다. 지침서가 명확하고 구체적일수록 에이전트는 더 효율적으로 탐색합니다. 모호한 지시는 에이전트를 배회하게 만듭니다.

4. 왜 AutoResearch가 혁신적인가?

압도적인 실험 처리량 (Throughput)

인간 연구자가 하루에 10~20개의 실험을 수동으로 돌려보며 결과를 기록하고 분석하는 동안, AutoResearch의 에이전트는 2일 만에 700개 이상의 실험을 자동으로 수행했습니다. 이는 인간 대비 약 20배 이상의 처리량 증가를 의미합니다.

검증 가능한 피드백 루프 (Verifiable Reward)

카파시가 현재의 AI 에이전트 '하이프(Hype)'에 대해 비판적인 시각을 가지고 있다는 점은 주목할 만합니다. 그는 완전 자율적인 범용 AI 에이전트(AGI Agent)는 아직 수십 년이 걸릴 것이라고 경고합니다. 하지만 AutoResearch가 작동하는 이유는 명확하고 객관적인 성공 지표(Verifiable Reward)가 존재하기 때문입니다.

"Validation Loss가 줄었는가?" — 이 질문에 대한 답은 "Yes" 또는 "No"밖에 없습니다. 에이전트가 할루시네이션을 일으키거나 주관적인 판단을 내릴 여지가 없습니다. 이것이 바로 AutoResearch가 '진짜 작동하는' AI 에이전트 패턴인 핵심 이유입니다.

범용 설계 패턴 (Design Pattern)

비록 AutoResearch는 ML 연구를 위해 태어났지만, 이 '자율 루프' 패턴은 측정 가능한 결과물이 있는 모든 영역에 적용할 수 있는 범용 설계 패턴입니다.

- 프롬프트 최적화: "이 프롬프트의 응답 정확도가 올라갔는가?"

- SEO 최적화: "이 메타 태그 변경으로 CTR이 올라갔는가?"

- 데이터 파이프라인 튜닝: "이 전처리 변경으로 처리 속도가 빨라졌는가?"

5. 카파시의 핵심 경고: "실행은 위임하되, 이해는 위임하지 마라"

카파시는 Software 3.0 시대에서 가장 위험한 함정도 경고합니다.

"AI에게 생각(Thinking, 실행)을 아웃소싱할 수는 있지만, 이해(Understanding, 판단)까지 아웃소싱해서는 안 됩니다."

AI 에이전트가 700개의 실험을 돌려주어도, 그 결과가 왜 좋아졌는지(또는 나빠졌는지)를 '이해'하는 것은 인간의 몫입니다. AI가 대량의 콘텐츠를 생산해주어도, 그 콘텐츠가 진짜 가치 있는지, 논리적으로 정합한지, 브랜드 보이스에 맞는지를 '판단'하는 것은 인간의 몫입니다.

카파시는 이를 "Taste(안목)"라고 부릅니다. AI 시대에 AI가 아무리 발전해도, 결국 최종 품질은 그것을 운영하는 인간의 안목과 판단력에 의해 결정된다는 것입니다.

결론: 연구자에서 오케스트라 지휘자로

AutoResearch는 우리에게 근본적인 역할 전환을 요구합니다.

과거의 연구자/개발자/마케터는 "어떻게(How) 실행할 것인가?"에 시간의 90%를 쏟았습니다. 하지만 Software 3.0 시대의 전문가는 "무엇을(What) 최적화할 것이며, 성공의 기준은 무엇인가?"를 설계하는 데 집중하고, 실행은 AI 에이전트에게 위임합니다.

마치 오케스트라의 지휘자가 악기를 직접 연주하지 않으면서도, 수십 명의 연주자들이 만들어내는 하모니의 최종 품질을 결정하는 것처럼요.

다음 2편에서는 AutoResearch 외에 스탠포드 STORM, OpenAI Deep Research, Perplexity, NotebookLM 등 다양한 AI 리서치 프레임워크를 비교 분석하고, 이 프레임워크들을 실제 블로그 자동화 파이프라인에 어떻게 적용하여 콘텐츠 품질을 극대화할 수 있는지 구체적인 실전 가이드를 제시하겠습니다.

📚 참고자료

- Karpathy, A. (2026). AutoResearch. GitHub Repository. karpathy.ai

- Karpathy, A. (2017). Software 2.0. Medium Blog Post.

- Karpathy, A. (2025). Vibe Coding. X (Twitter) Post.

- PyTorch Korea (2026). 카파시의 AutoResearch 분석. pytorch.kr

- Mager, S. (2026). Deep Dive into Karpathy's AutoResearch Framework. mager.co

- Hacker News / GeekNews (2026). AutoResearch: AI 에이전트가 연구를 대신하는 방법. hada.io

💡 AI Learnings 의 다른 글

전체보기→[AI 개발 자동화] Gemini CLI Superpowers 완벽 가이드 및 실전 유스케이스

단순한 터미널 챗봇을 완벽하게 규율 잡힌 시니어 엔지니어로 바꿔주는 Gemini CLI Superpowers 확장의 14가지 핵심 스킬과 실전 활용법을 소개합니다.

[Antigravity 활용 가이드 3] 오픈소스 Skill로 코딩 자동화 파이프라인 구축하기

Gemini CLI의 꽃이라 할 수 있는 Skill 시스템을 이해하고, 오픈소스로 공개된 다양한 스킬을 확장하여 강력한 코딩 자동화 워크플로우를 구축하는 방법을 알아봅니다.

[AI 개발의 미래] Gemini CLI Superpowers vs Antigravity 에이전트 전격 비교

최근 인공지능(AI) 코딩 어시스턴트 시장은 단순한 '코드 자동 완성' 시대를 넘어, 개발자의 워크플로우를 주도적으로 설계하고 실행하는 **'에이전트 기반(Agentic) 개발'** 시대로 접어들었습니다 [1]. 그 중심에는 터미널 환경을 AI 통합 워크스페이스로 변모...

[AI 개발의 혁신] FastMCP란 무엇이며, 왜 사용해야 하는가?

**MCP(Model Context Protocol)**는 대규모 언어 모델(LLM)을 외부 데이터 소스 및 도구와 안전하게 연결해주는 개방형 표준 프로토콜로, 종종 'AI를 위한 USB-C 포트'에 비유됩니다 [1, 2]. 하지만 이 프로토콜의 스펙을 직접 구현하는...

Model Context Protocol (MCP) 완벽 가이드: AI 에이전트 통합의 새로운 표준

**Model Context Protocol (MCP)**는 2024년 11월 Anthropic이 발표한 오픈 소스 표준으로, AI 애플리케이션이 외부 시스템 및 데이터 소스와 원활하고 안전하게 연결될 수 있도록 돕는 범용 프로토콜입니다 [1], [2]. 과거에는 A...

[Antigravity 활용 가이드 2] 토큰 한계를 넘는 비법: YOLO 모드와 청킹(Chunking)

Gemini CLI의 강력한 기능인 YOLO 모드를 활용한 브레인스토밍 이터레이션 기법과 제한된 컨텍스트 윈도우를 효율적으로 극복하는 청킹(Chunking) 기술을 소개합니다.

[Antigravity 활용 가이드 1] Antigravity와 Gemini CLI, 어떻게 다르게 써야 할까?

Agentic AI 코딩 어시스턴트인 Antigravity와 강력한 터미널 도구인 Gemini CLI의 차이점을 알아보고, 각 도구를 어떤 상황에서 어떻게 활용해야 완벽한 시너지를 낼 수 있는지 분석합니다.